哎哟喂,兄弟集美们!不知道你们发现没有,这2026年才刚开了个头,咱们这AI画图的圈子简直比过年赶大集还热闹。今儿个字节跳动的Seedream5.0刚说要给咱画能看懂棋谱的图 -4,明儿个Google的Nano Banana Pro就喊着能让图片里的中文字不乱码了 -3。作为一个从Midjourney V3就开始踩坑的老油条,我每天打开社交媒体,满屏都是那种“一眼AI”但就是画不对手指数的图,看得我真是又好笑又捉急。

咱今儿个不聊那些虚头巴脑的技术参数,什么Transformer架构、扩散模型,咱老百姓听得脑壳疼。我就用咱的大白话,掰扯掰扯现在这乱花渐欲迷人眼的AI绘图工具,咱们到底应该怎么“整合”着用,才能不光图一乐,真能省点事儿、办点正事儿。

说实话,现在如果你还停留在“AI画图就是输几个词出张美女图”的阶段,那你可真是亏大发了。现在的战场早就变了,已经从“比谁画得更好看”变成了“比谁更好用” -7。这就像以前咱们比谁的菜刀更锋利,现在比的是谁家的菜刀不仅能切菜,还能自己根据菜谱把菜配好,甚至告诉你这菜有多少热量。

第一个最让我这强迫症舒服死的进化,就是关于“写字”这件事。你们有没有过这种经历?想做个海报,明明提示词里写了“大大的‘限时抢购’四个字”,结果出来的图,那上面的字跟鬼画符一样,要么是根本不存在的乱码,要么就是缺胳膊少腿的英文。这玩意儿以前发朋友圈都嫌丢人。

但现在不一样了,这就是我要说的第一个“AI绘图 整合”的新信息:整合了多语言渲染能力的模型,才能真正帮你干活儿。 比如说Google家新出的那个Nano Banana Pro,我亲自试了试(虽然我这破电脑跑起来风扇跟直升机似的),它现在真的能在生成的图里把中文字写得板板正正 -3。你让它画个菜单,它真能给你把“宫保鸡丁 38元”这行字给老老实实渲染上去,不再是那种像蚯蚓爬的鬼画符。这对于咱想做点小生意、发个传单海报的人来说,简直是救星!以前还得先AI生图,再拖进PS里吭哧吭哧打字,现在一步到位,这就叫生产力的“整合”。

当然了,光能写字还不够,咱还得解决“听话”的问题。以前的AI像个耳背的老大爷,你跟它说“给我画一个左边站个穿红衣服的姑娘,右边蹲着条大黄狗,背景得是傍晚的海滩”,它往往给你整出一张红衣服姑娘骑着大黄狗在沙漠里狂奔的离谱玩意儿。

但现在呢?通过深度整合视觉逻辑,新模型终于开窍了。比如字节跳动前几天放出来的Seedream5.0Lite,它居然能理解物理规律了 -4!你敢信?官方例子是它能根据围棋残局推理下一步咋走,然后生成对应的棋谱。虽然咱不下围棋,但这背后代表的意义是啥?是它能搞懂“如果把这三张不同的零件图放一起,能拼成个啥玩意儿”。这就是我要说的第二个“AI绘图 整合”:整合了视觉推理能力,AI才算长了脑子。 以前咱叫它“人工智能”,有时候感觉像“人工智障”;现在它好歹能明白点事儿了,知道玻璃杯掉地上会碎,知道把大象放进冰箱得开三步。这种“整合”思维,让AI生图从纯粹的“瞎猫碰死耗子”变成了有点逻辑的创作,那些离谱的错误肉眼可见地在变少。

咱们再说点实在的,就是关于“怎么整”的技巧。现在很多大厂都在搞生态闭环,啥叫闭环?就是你在这个软件里生的图,能直接拖到另一个剪辑软件里接着改,不用导来导去损失画质 -2。这对于咱们这些懒得折腾的人来说,太重要了。

但真正让我觉得“哎呦,不错哦”的,是整合了多图融合与精准编辑的功能。腾讯混元图像3.0不是说大话,它现在能让你实现“一句话P图” -8。什么意思呢?就好比你拍了张照片,觉得背景太乱,你直接跟AI说“把背景换成人民大会堂”,它“唰”一下就给换了,而且光影啥的都给你匹配好。或者你想做个九宫格表情包,以前你得一张张做,现在你跟AI说“给这只猫生成九宫格表情包”,它自己就能琢磨出来啥是“九宫格”,啥是“表情包”,然后给你产出一套风格统一的图 -8。

这背后其实是对多模态理解的高度整合。模型不再只是看一张图,它是真的在“读”你的心思,结合它见过的千万张猫片儿,来揣测你说的“九宫格表情包”到底长啥样。这种“整合”带来的结果就是,AI从一个被动的工具,变成了一个能跟你打配合的“乙方”。虽然这个乙方偶尔还是会耍点小性子(比如把我的猫生成六个耳朵),但比以前那个完全没法沟通的乙方强太多了。

不过嘞,咱也得说点不好听的,降降火。虽然现在这些工具吹得天花乱坠,什么“一键生成可编辑UI设计稿” -6,什么“4K高清无损放大”,但在我这种手残党实际用下来,还是有不少坑的。比如有些工具所谓的“整合”,其实就是把几个功能粗暴地塞进一个界面,用起来卡得要死,而且经常崩。还有些模型,特别是处理复杂指令的时候,你稍微多说两句,它就懵了,开始给你“自由发挥”,气得你肝疼。

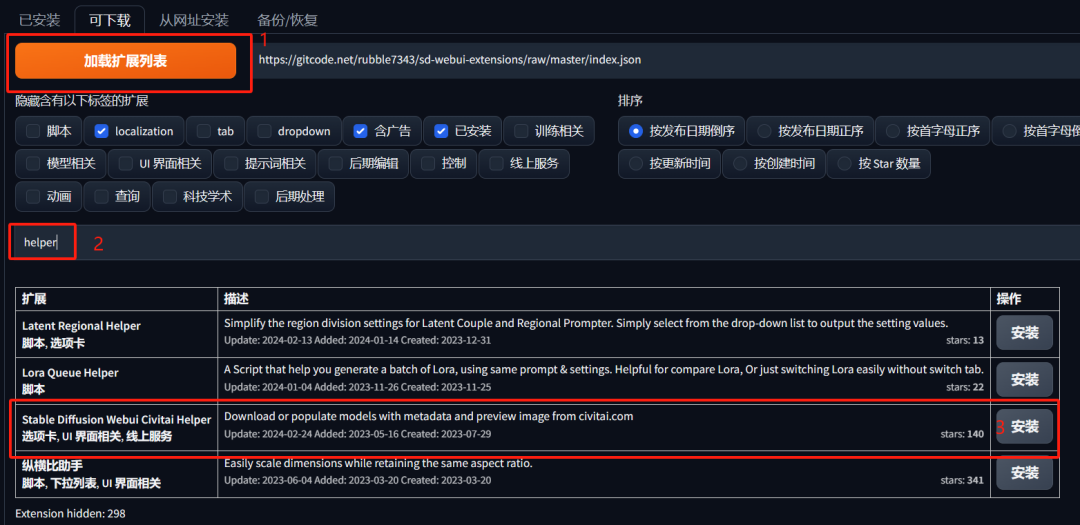

所以,咱们在进行“AI绘图 整合”的时候,心里得有杆秤。你得先想明白你到底要啥。你是要画那种艺术感爆棚、当壁纸的图?那可能还是MJ或者SD的生态更适合你,配合各种Lora模型慢慢调 -5。你要是想高效产出能做自媒体的素材,比如那种“一张图看懂XXX”的信息图,那现在Google那一套整合了NotebookLM和Gemini的工具链就特别香 -3,它能直接把你丢给它的一堆论文资料,变成一张逻辑清晰的图表,省得你自己再画框架、找配图。

你要是干电商的,那字节系那套从生图到剪映剪辑的全套流程就必不可少,人家连积分限免活动都给你安排得明明白白 -2。你要是搞UI设计的,那必须得用Pixso这种能生成矢量图层、能直接编代码的玩意儿,否则你拿个位图去糊弄开发,人家非得拿刀砍你 -1-6。

说到这,我就想起前阵子帮朋友做的一个破事儿。他那小饭馆要换菜单,以前找个设计师,一张破菜单报价两千,还得等一星期。我就拿新出的这些AI工具给他“整合”了一把。先用一个模型根据他给的菜品照片和价格,生成了一个带中日双语文案的菜单版式 -3,然后又用另一个带检索功能的模型,根据当季食材推荐了几个新菜并生成了诱人的配图 -4,最后用了个在线设计工具微调了一下排版,全程没超过俩小时。虽然最后印出来的颜色稍微有点偏差(那可能是印刷店的问题,这锅AI不背),但整体效果绝对对得起那顿饭钱。这叫什么?这才叫“整合”的力量,把不同工具最强的点攒到一起,解决实际问题。

所以说,2026年了,别再纠结于哪个AI画图最好看。好看有用吗?好看不能当饭吃。咱们得关注的是这些工具能不能“整合”进咱们的生活和工作流。它能不能懂咱那些带口音的普通话指令?能不能在生成海报的时候把字儿给我整对了?能不能把我给的几张乱七八糟的素材图融成一张看着不违和的玩意儿?能不能在我需要改细节的时候,只改那一小块儿,而不是把整张图给我重画一遍?

未来的AI绘图,绝对不是一家独大。一定会是各家有各家的绝活,比如有的特别会画人像,有的特别会生成UI界面,有的特别擅长做数据图表。咱们要做的,就是当一个聪明的“包工头”,把这些各有神通的“AI民工”整合起来,让它给咱们干活。

最后的给大伙儿提个醒。现在虽然很多平台都说生成图片可以商用 -3,但涉及到具体的版权问题,比如你让它画个米老鼠,它给你画了个神似的,这玩意儿你印T恤上卖,迪士尼的法务部可不管你是不是AI画的。这方面的风险,咱还是得自己把好关。

得,今儿就啰嗦这么多。AI这玩意儿,一天一个样,我也是边学边用边踩坑。如果你们有啥好用的新工具,或者有啥搞笑的翻车图,欢迎来跟我分享分享。咱们下回再聊!