淘宝十年架构变迁

你是不是也好奇,支撑“双11”千亿成交额的系统究竟是如何搭建与演进的?我在深入研究高并发架构时,发现了一篇极具启发的演进剖析,堪称架构师的“实战地图”。今天就将这份精华梳理并分享给你,相信无论是拓宽视野还是应对实际挑战,都能让你收获满满!

1. 架构演进全景:一场应对增长的持续战斗本文将以大家熟悉的淘宝为例,生动演绎一个系统如何从默默无闻做到支撑千万级、乃至亿级并发。我们将一同走过从单机到分布式,再到云原生的完整演进路径,剖析每个阶段的核心挑战与破局技术。还会为你提炼出经得起考验的架构设计原则。无论你是初学者还是资深开发者,都能从中获得对架构演进的整体认知与实战启发。

特别说明:本文以淘宝为例旨在构建一个清晰易懂的技术演进叙事框架,便于理解各阶段的核心问题与解决方案,并非描述淘宝实际的技术发展史。

2. 核心基石:必须掌握的架构基础概念在深入复杂的架构图之前,我们先统一语言,理解几个最核心的基石概念:

分布式

系统不同模块部署于不同服务器,协同工作。例如,将Web应用(Tomcat)和数据库分别部署,或部署多个相同的应用实例,即构成分布式系统。

高可用

当系统中部分节点故障时,其他节点能自动接管服务,保障业务不间断。这是构建稳健系统的生命线。

集群

多台服务器协同作为整体提供同一类服务。一个高可用的集群,对外如同一个永不间断的服务节点。

负载均衡

将海量用户请求智能、均匀地分发到集群中的多个节点,避免单点过载,是提升系统吞吐量的关键手段。

正向代理与反向代理

正向代理代表内部系统访问外部世界,是客户端的“代言人”;反向代理代表系统接收外部请求并分发给内部服务,是系统的“总入口”和“调度员”。二者是内外部网络通信的核心枢纽。

3. 演进之路:十五次关键架构升级实战3.1 单机架构:一切的起点

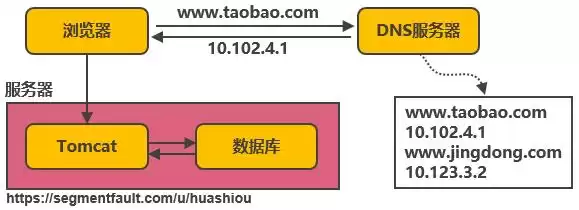

想象淘宝诞生之初,用户寥寥。最简单的架构便是将所有东西(应用、数据库)部署在一台服务器上。用户访问域名,DNS解析IP,请求直达这台唯一的服务器。

随着用户涌入,应用与数据库在单机上激烈争夺CPU、内存、IO资源,性能瓶颈迅速出现。

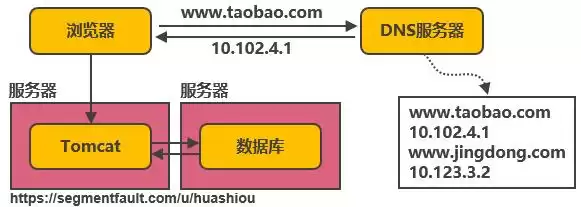

3.2 第一次演进:应用与数据分离

最直接的解耦方案:将Tomcat和数据库拆开,部署到独立的服务器上。让计算和存储各司其职,资源竞争问题迎刃而解。

用户持续增长,集中式的数据库成为新的枷锁,频繁的并发读写使其不堪重负。

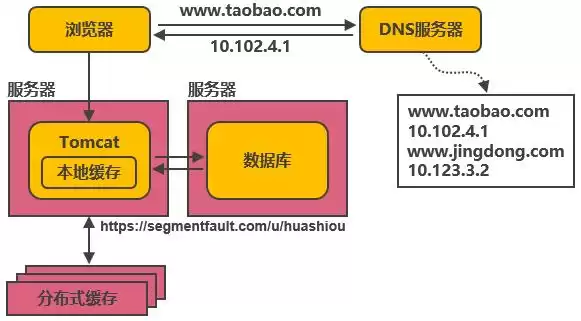

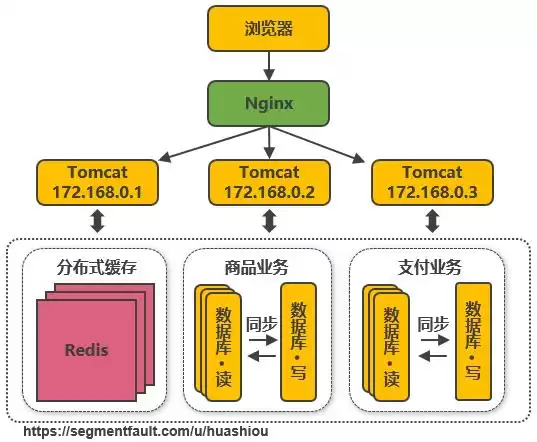

3.3 第二次演进:引入缓存,拦截数据库洪峰

战术:引入缓存层。在应用本地或外部搭建分布式缓存(如Redis),将热点数据(爆款商品信息、页面)置于其中。80%的读请求在抵达数据库前被拦截,数据库压力骤降。

此阶段需掌握缓存技术选型(Memcached/Redis),并应对缓存一致性、穿透、雪崩、击穿等经典挑战。

缓存抵挡了大部分读请求,但写操作和未命中缓存的请求,仍使单点应用服务器成为响应延迟的源头。

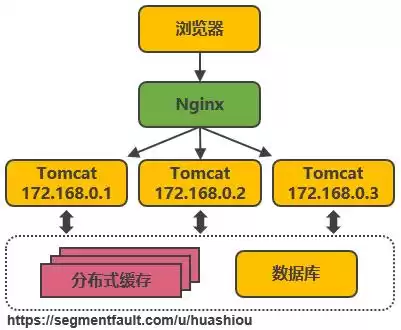

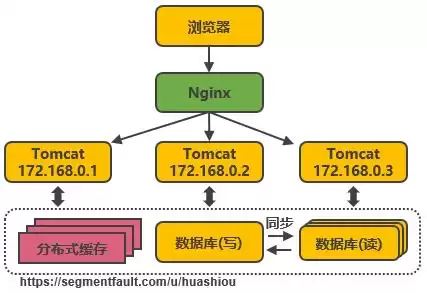

3.4 第三次演进:负载均衡,扩展应用集群

策略:水平扩展。部署多个Tomcat实例,在前端引入反向代理(如Nginx)进行流量分发。一个Nginx支撑数万并发,将请求均匀分摊到后端的应用集群,处理能力成倍增长。

技术要点包括Nginx/HAProxy配置,以及随之而来的Session共享、文件上传等分布式问题。

应用层扩展后,更多请求穿透至数据库,单点数据库的写入和复杂查询成为整个系统的阿喀琉斯之踵。

3.5 第四次演进:数据库读写分离,缓解写库压力

解耦读写:设立主库(写)和多个从库(读),通过主从复制同步数据。读请求被分摊到多个从库。对“读己之所写”有强一致性要求的场景,可借助缓存兜底。

此阶段常引入数据库中间件(如Mycat)管理数据源,并需处理主从延迟、数据一致性等难题。

业务线日益丰富,商品、交易、用户等不同业务的数据表共存一库,相互抢占资源,慢查询可能拖垮整个平台。

3.6 第五次演进:垂直分库,业务数据隔离

按业务划分数据库,例如拆分成商品库、订单库、用户库。业务间实现资源隔离,高访问量的业务可独立扩容。代价是跨库关联查询变得复杂,需通过其他技术手段(如全局表、数据冗余)解决。

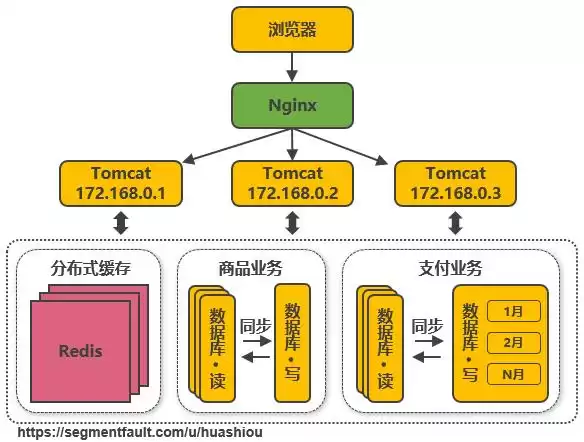

单业务数据量持续暴增(如十亿级订单),即便单独一个写库,其性能和存储也终将到达极限。

3.7 第六次演进:水平分表,分布式数据库初现

将单张海量表按规则拆分。例如,订单表可按用户ID哈希或按时间范围分到多个数据库的多个表中。数据分散,读写负载也随之分散,理论上可通过无限增加节点来扩展能力。

这本质上是走向分布式数据库。业界有Greenplum(OLAP)、TiDB(HTAP)、Snowflake等成熟方案,它们封装了分库分表、分布式查询、事务等复杂性,极大降低了运维门槛。

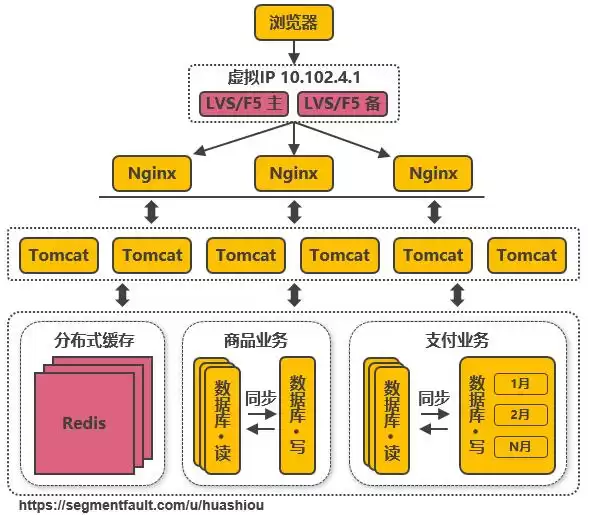

数据库和应用的扩展性问题初步解决,但所有流量都汇聚于入口的Nginx,单点Nginx在数十万并发下成为新瓶颈。

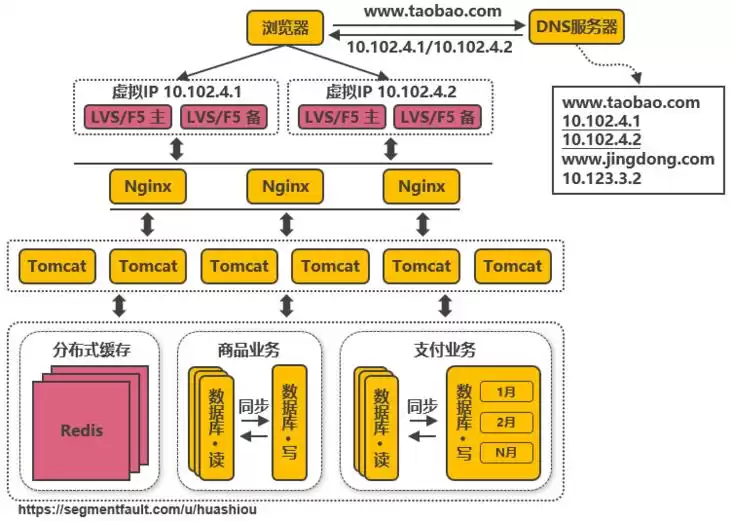

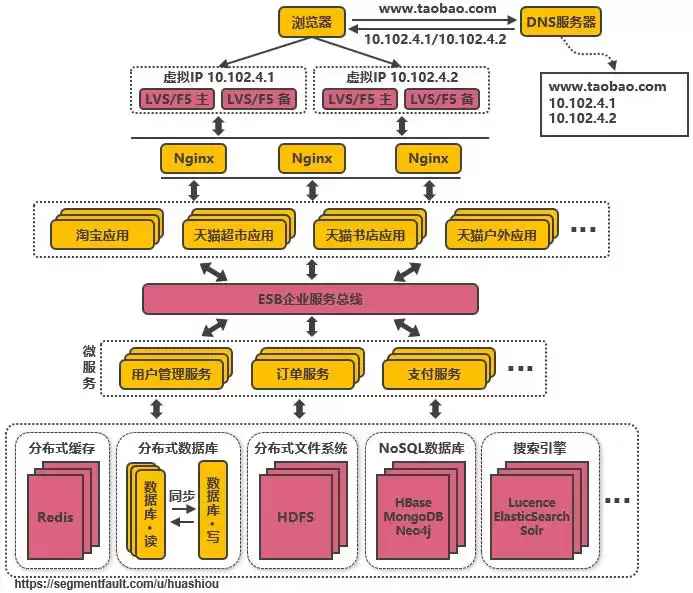

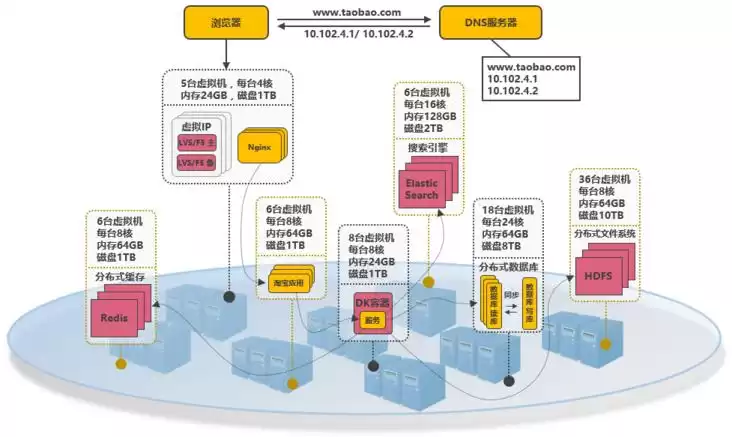

3.8 第七次演进:LVS/F5,负载均衡的高可用集群

在Nginx上层引入LVS(软件)或F5(硬件)这类四层负载均衡器。它们性能更强,可支持百万级连接。通过Keepalived实现虚拟IP和主备切换,构建高可用的负载均衡层。

单一数据中心内的扩展已达极致。当用户量突破千万乃至亿级,遍布全国的用户面临网络延迟差异,单一机房无法提供良好体验。

3.9 第八次演进:DNS轮询与多机房部署

在DNS层面配置一个域名对应多个机房IP。用户访问时,DNS根据地理位置或轮询策略返回最近机房的IP。实现跨机房负载均衡与容灾,支撑亿级并发。

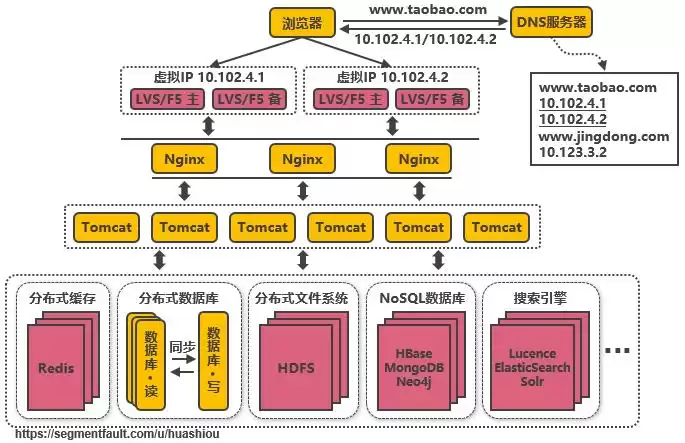

高并发访问解决后,海量数据催生出多样化需求:精准搜索、实时分析、用户画像……传统关系型数据库力不从心。

3.10 第九次演进:多元化数据基础设施

引入专用系统应对特定场景:Elasticsearch处理全文检索;HBase、Redis服务KV查询与缓存;HDFS存储海量文件;Spark、Flink进行实时与批量计算。技术栈多元化,但系统复杂度飙升,需解决数据同步、一致性等挑战。

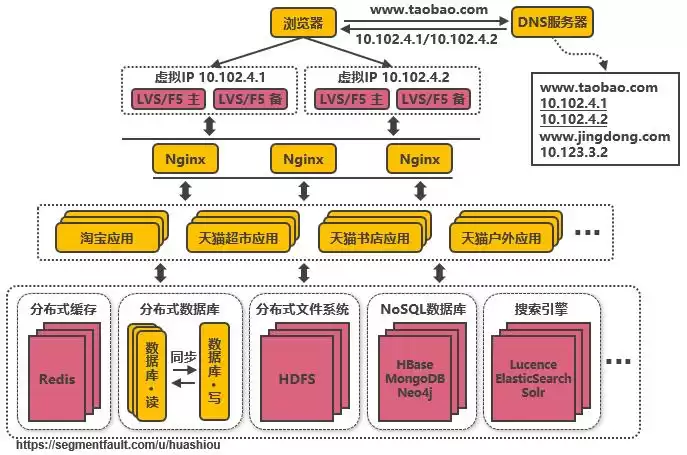

随着功能膨胀,所有业务代码挤在单一应用中(单体架构),导致代码耦合严重,编译部署缓慢,牵一发而动全身。

3.11 第十次演进:应用拆分,走向SOA雏形

按业务领域(如商品、交易、用户)将巨型应用拆分为多个独立的应用(服务)。每个应用独立开发、部署、伸缩。通过分布式配置中心(如Zookeeper、Nacos)管理公共配置。

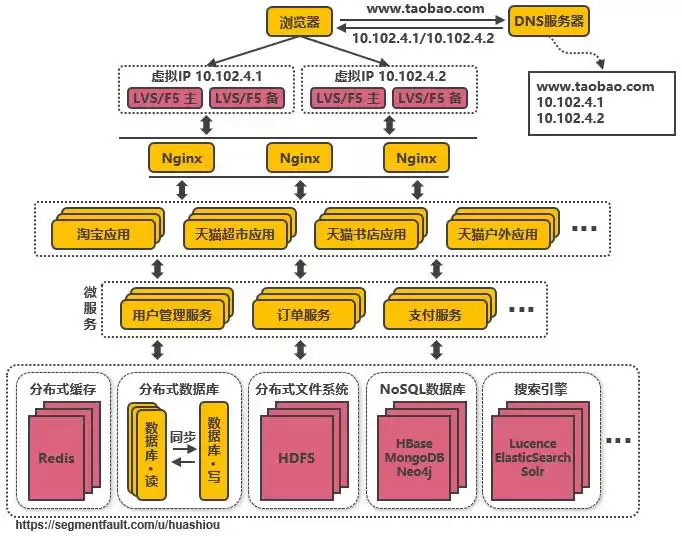

拆分后,用户管理、支付等通用功能在不同应用中重复开发,导致代码重复,公共模块升级困难。

3.12 第十一次演进:抽取微服务,实现能力复用

将公共能力(用户中心、支付服务)抽取为独立的微服务。应用间通过HTTP、RPC等协议调用服务。引入Spring Cloud、Dubbo等生态,实现服务治理、熔断、限流。

服务数量激增,调用关系网变得错综复杂。不同的通信协议、接口规范让服务集成和治理异常艰难。

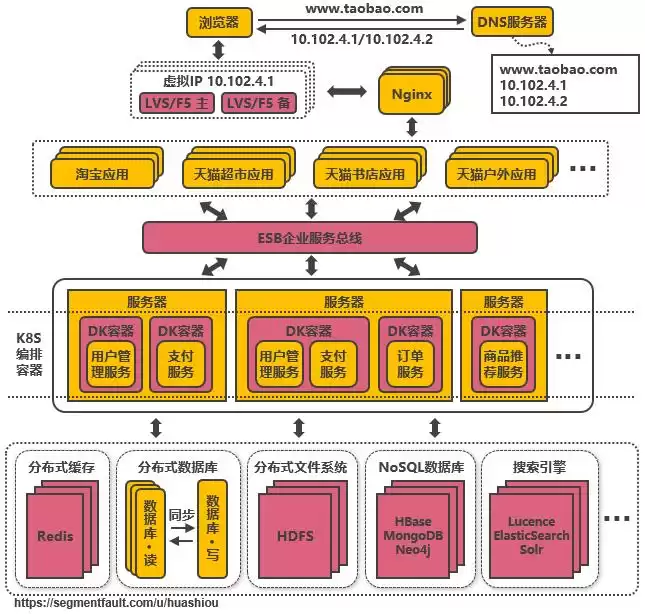

3.13 第十二次演进:引入ESB,统一服务总线

通过企业服务总线(ESB)统一协议与数据格式。所有服务通过ESB交互,解耦服务间依赖。这种通过服务化、总线化构建的架构,即为SOA(面向服务架构)的典型形态。

服务与应用的部署、依赖管理、资源隔离问题凸显。在大促时需要快速扩容,手动部署效率低下,环境差异导致问题丛生。

3.14 第十三次演进:容器化与K8S,标准化交付与调度

采用Docker将应用及其依赖打包成标准镜像。通过Kubernetes(K8S)实现容器的自动部署、扩缩容与管理。秒级启动、环境一致、资源隔离,彻底解决部署与运维难题。

容器化解决了软件部署问题,但硬件资源仍需自购、自维。为应对峰值流量,必须长期保有大量闲置服务器,成本高昂。

3.15 第十四次演进:全面上云,拥抱Serverless

将系统部署到公有云。利用云平台(IaaS/PaaS/SaaS)的弹性,按需动态申请计算、存储、网络资源。结合容器化技术,实现分钟级弹性伸缩,真正做到按使用量付费,极大提升资源利用率和运维效率。

至此,我们完成了一场从单机到云端、支撑亿级并发的架构长征。当然,真实的征程还包括分布式事务、数据同步、全链路监控等更多复杂议题,我们有机会再深入探讨。

4. 架构心法:原则、策略与常见问题解答架构演进必须遵循上述路径吗?当然不是!这只是一条理想化的单线叙事。现实中,多个瓶颈可能并发,需根据实际业务痛点(高并发、高复杂度、快速迭代)选择最迫切的优化方向。

架构应该设计到什么程度?对于目标明确的项目,设计到满足当前及可预见未来的需求即可,但需预留扩展接口。对于高速发展的平台(如电商),则需为下一阶段的用户量和业务复杂度做好准备,并保持持续演进的能力。

服务端架构与大数据架构有何不同?服务端架构关注应用的组织、协同与高并发服务;大数据架构则聚焦于海量数据的采集、存储、计算与分析,为上层应用提供数据能力。二者相辅相成,共同构成现代互联网企业的技术基石。

有哪些值得遵循的架构设计原则?

N+1设计:避免任何单点故障,关键组件至少有一个备份。

可回滚设计:任何变更都必须支持快速、平滑的回滚。

功能开关:新功能或高风险功能应有开关,出事时可快速降级。

设计即监控:架构阶段就需规划可观测性(监控、日志、链路追踪)。

多活与异地容灾:对可用性要求极高的业务,需考虑多数据中心部署。

选用成熟技术:谨慎对待未经大规模验证的新技术,稳定压倒一切。

资源隔离:核心业务与非核心业务、不同用户间应做资源隔离。

水平扩展:设计上应支持通过增加机器来提升能力,而非单纯升级硬件。

非核心则购买/外包:将资源聚焦于核心业务竞争力,通用功能可考虑成熟产品。

商用硬件:在大多数场景下,商用硬件的稳定性与运维支持优于自建。

小步快跑,快速迭代:通过快速验证最小可行产品(MVP)来降低项目风险。

无状态设计:服务接口尽可能设计为无状态,便于水平扩展和故障恢复。

希望这份从实战中提炼的架构演进图与心法,能为你带来启发。架构之路没有终点,唯有持续学习与进化。你在实践中遇到过哪些架构挑战?或者对哪个演进阶段特别感兴趣?欢迎在评论区分享与交流!

作者:huashiou

https://segmentfault.com/a/1190000018626163

相关问答

淘宝网采用的是B/S还是C/S架构?

淘宝网是典型的B/S(Browser/Server,浏览器/服务器)架构。用户通过浏览器访问,业务逻辑和数据处理主要在服务器端完成。C/S(Client/Server)架构则需要安装独立客户端,常见于早期软件或对性能、离线操作有特殊要求的应用。

设计淘宝秒杀系统需要考虑哪些核心问题?

秒杀系统是极端的高并发场景。核心挑战与解决方案包括:1. 流量削峰:通过验证码、答题、排队机制避免请求瞬间洪峰。2. 库存扣减:采用Redis预扣库存+异步下单,保证准确性和性能。3. 防刷与公平:限流、黑名单、同一用户ID限制。4. 系统隔离:将秒杀系统与主交易链路隔离,避免影响正常服务。5. 极致性能:热点数据缓存、静态化页面、简化业务流程。

淘宝为何选择Java作为后端主要技术栈?

淘宝在发展过程中,其技术栈经历了演进。早期为快速迭代曾使用PHP等语言。随着业务复杂度与规模爆发,Java因其强大的生态系统(Spring等框架)、成熟的并发处理能力、优秀的跨平台性、海量人才储备以及在大规模分布式系统中久经考验的稳定性,逐渐成为其核心后端语言,支撑起复杂的微服务架构与高并发场景。

天猫隶属于哪个公司?

天猫是阿里巴巴集团旗下的综合性B2C(企业对消费者)线上购物平台。原名“淘宝商城”,后独立为天猫,与淘宝(C2C)、阿里云等共同构成阿里巴巴的核心商业生态。

如何在淘宝查看自己的总消费金额?

打开手机淘宝APP,点击右下角【我的淘宝】,在左上角找到并进入【淘宝人生】。在淘宝人生主页点击右上角的【成就】,即可查看包含总消费金额在内的多项个人数据总结。

淘宝上的廉价“志强Xeon”多核CPU值得买吗?

p>需谨慎。这些多为淘汰的服务器拆机CPU,虽然核心数多,但架构老、单核性能弱、功耗高,且搭配的主板多为山寨品。对于大多数游戏和日常应用,其体验可能远不如新一代的主流消费级CPU。更适合预算极其有限、用于特定计算或学习用途的用户。

有人说Web开发技术含量低,你怎么看?

这是一种误解。搭建一个简单的展示页面确实门槛不高。但开发一个支撑海量用户、高并发、高可用、高安全、具备复杂业务逻辑的现代Web系统(如淘宝),需要深入理解计算机网络、操作系统、数据库、分布式架构、中间件、性能优化、安全防护等众多知识,技术深度和广度要求极高。

为何许多传统企业仍偏爱Oracle而非MySQL?

原因包括:1. 稳定与可靠:Oracle在超大型复杂事务处理上历史悠久,可靠性有背书。2. 生态与服务:拥有完整的企业级工具链和强大的原厂技术支持。3. 技术债与风险:早期系统基于Oracle构建,迁移成本高、风险大。4. 行业合规:某些行业对软件供应商有特定认证要求。

金蝶专业版与高级版的主要区别?

金蝶专业版面向中小型企业,提供财务、供应链、生产等标准管理功能。高级版(通常指K/3或EAS版本)面向中大型集团企业,功能更全面,支持更复杂的组织架构、多法人核算、集团财务管控、智能制造及更强大的BI分析,并能与OA、电商平台(如淘宝、京东)等进行深度集成。

为什么像Facebook这样“看起来简单”的网站需要大量顶尖工程师?

“看起来简单”的背后,是极端复杂的系统工程。需要应对全球数十亿用户的并发访问,实现信息毫秒级推送,处理PB级数据并完成精准推荐,同时保障系统99.99%以上的可用性,防御各种安全攻击,并支持快速的功能迭代。这需要顶尖工程师在分布式系统、数据库、算法、AI、网络、安全等领域的深厚造诣,其技术复杂度远超表面所见。