你有没有过这样的经历?家里那台号称“人工智能”的扫地机器人,在光滑的地板上溜得飞快,可一遇到你心爱的长毛地毯,就跟见了鬼似的,要么绕着走,要么干脆“死机”报错-7。你可能会纳闷,这机器人是不是“眼神”不好?其实啊,这事儿真不赖它“笨”,根子出在它的“感官系统”——也就是我们今天要聊的机器人传感器技术上。它就像机器人的眼睛、耳朵和皮肤,但现阶段,这套感官离真正理解咱们这个复杂世界,还差着点意思-7。

感官的进化:从“独眼龙”到“千手观音”

早年的工业机器人,就像个高度近视还只睁一只眼的工人,全靠几个简单的开关和编码器感知位置,在围栏里重复着拧螺丝、搬箱子的活-6。它们“感觉”不到力的大小,也“看”不清环境的细微变化。

现在的机器人可不同了。它们装备了琳琅满目的传感器,堪称感官大爆发。激光雷达(LiDAR)像蝙蝠一样发射激光,通过回波精确绘制出房间的3D地图;视觉摄像头模仿人眼,不仅能识别物体是茶杯还是书本,还能读懂上面的文字-1。惯性测量单元(IMU)则时刻感受着自己的姿态和加速度,防止自己摔倒-1。这些技术进步,让机器人从固定的工位走向了动态的世界。

但是,你猜怎么着?单一感官再强,也有致命的短板。激光雷达遇到透明的玻璃门或反光的镜子,信号就直接“穿”过去了,可能导致机器人一头撞上-1。摄像头在光线昏暗或者强光直射时,也容易“抓瞎”-1。这就好比人蒙上一只眼睛走路,对距离的判断立马会失准。

所以,现在的机器人传感器技术正朝着一个核心方向狂奔:多传感器融合。说白了,就是让激光雷达、摄像头、IMU甚至毫米波雷达等“十八般武艺”同时上阵,各取所长-1-4。通过卡尔曼滤波、神经网络这些复杂的算法,把不同传感器发来的信息“炖”成一锅高汤,综合判断前面到底是一块地毯还是一个台阶-1。这条路子,正是为了解决机器在复杂真实场景中“感知不全、容易上当”的痛点。

最大的短板:缺失的“触觉”

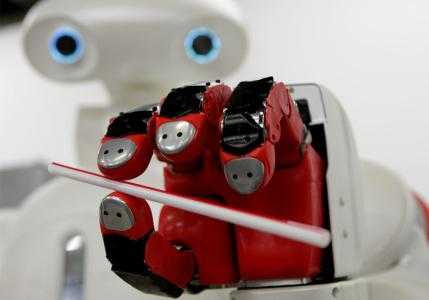

即便是多传感器融合,也弥补不了一个关键感官的缺失——触觉。你可以想想,我们人类用手拿一个鸡蛋,是靠眼睛精准测量蛋壳厚度吗?不是,我们是靠手指的触感和力反馈,来微妙地控制力道。当下的机器人,缺的就是这套“手感”。

没有触觉,机器人就只是个精致的“瞎子”。它可能用视觉引导机械手成功地抓起了水杯,但根本不知道握力是轻了还是重了,是可能捏碎玻璃杯,还是根本没拿稳。这让需要精细操作的服务机器人、医疗机器人难以真正落地。这也正是为什么,在CES 2026这样的全球科技盛会上,最引人瞩目的不再是机器人翻跟头,而是它们手上的“皮肤”和“指尖”-5-9。

好消息是,突破正在发生。中国的创业公司们正在这个领域大放异彩。像深圳的猿声科技,它们做出了每平方厘米能集成361个感知单元的指尖传感器,能像人的指纹一样敏锐地感知压力分布-5。更厉害的是,他们能把机器人全身覆盖“皮肤”的成本降到了千元级别,这价格过去可能只够买一个国外的传感器-5。另一家公司帕西尼感知,则直接展示了从高精度六维力传感器到“触觉数据生产线”的全链路,他们甚至能年产近2亿条触觉数据,用来训练机器人的“手感”-9。

这些创新意味着什么?意味着机器人传感器技术正在攻克最后的堡垒,让机器从“看得见”迈向“摸得着”。未来,机器人帮你捏肩捶背时,它会知道用多大的力;帮你拿取易碎品时,它会拥有最轻柔的“指法”。这背后,是传感、材料、算法一系列技术的协同突破。

未来已来:更小、更智能、更融合

展望明天,机器人的感官还会进一步“进化”。传感器本身会变得更微型、更智能。MEMS(微机电系统)技术会让传感器小到可以嵌入机器人的每一个关节-6。同时,传感器内部也会集成更强大的AI芯片,做到“传感即计算”,直接在本地判断异常,而不用把所有数据都上传云端,这样反应更快、也更安全-4。

“感存算一体”可能会成为终极形态。未来的传感器或许像我们的神经末梢一样,感知、存储、计算功能深度融合,实现极致的能效和速度-2。通信与感知的界限也在模糊,未来的6G网络信号可能同时用于通信和周围环境的扫描感知-4。

市场数据最不会说谎。报告显示,全球人形机器人用的传感器市场,正以每年42%的惊人速度膨胀-8。这背后,是无数工厂盼着更灵巧的机械臂,是无数家庭期待更贴心的机器人伴侣。传感器,就是实现这一切梦想的基石。

所以,下次当你家扫地机又在长毛地毯前犯傻时,或许可以多一份理解。它正处在一场宏伟的感官革命之中。从懵懂的“独眼龙”,到逐渐学会眼耳并用的“探险家”,再到未来将拥有细腻触感的“能工巧匠”,机器的每一次“感官觉醒”,都在让它们更懂我们的世界,也更懂我们。这条路还长,但方向已然清晰——那就是打造一套比人类更全面、更可靠、更值得信赖的机器感官。