AI图像生成技术发展史:从像素艺术到智能创作的技术革命

你知道吗?如果你告诉1960年代的计算机科学家,未来机器只需一句话就能画出逼真图像,他们一定会嗤之以鼻。但今天,这已不再是科幻!经过六十余年技术迭代,AI不仅学会了“画画”,更掀起了一场创意革命。现在,就让我们一起穿越时光,探索这场从像素到智能的震撼旅程。

从最初笨拙的几何图形,到今天轻松生成“红蓝色动力甲蜘蛛侠背上带蜘蛛义肢”的惊艳作品,AI图像生成的进化堪称奇迹。曾经设计师一周的工作量,如今只需几秒。但这条路布满荆棘,每个突破背后,都是人类智慧的闪光。AI究竟如何一步步掌握“创作”的奥秘?

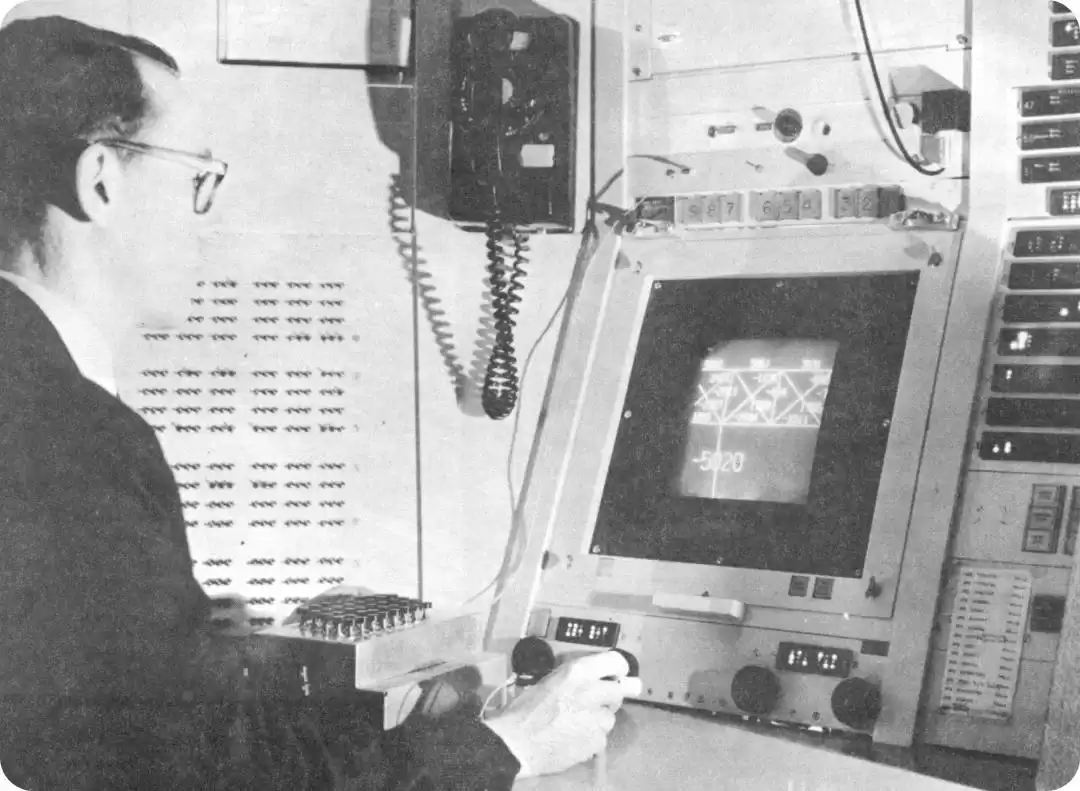

一切从Sketchpad开始

时间回到1963年。MIT博士生Ivan Sutherland开发的Sketchpad,如同计算机的“第一支画笔”。在多数人未见计算机真容的年代,Sutherland已用光笔在屏幕上直接作画。这一创举不仅奠定了计算机图形学基石,更埋下了AI绘图的种子——机器第一次理解了“图形”。

神经网络的早期萌芽

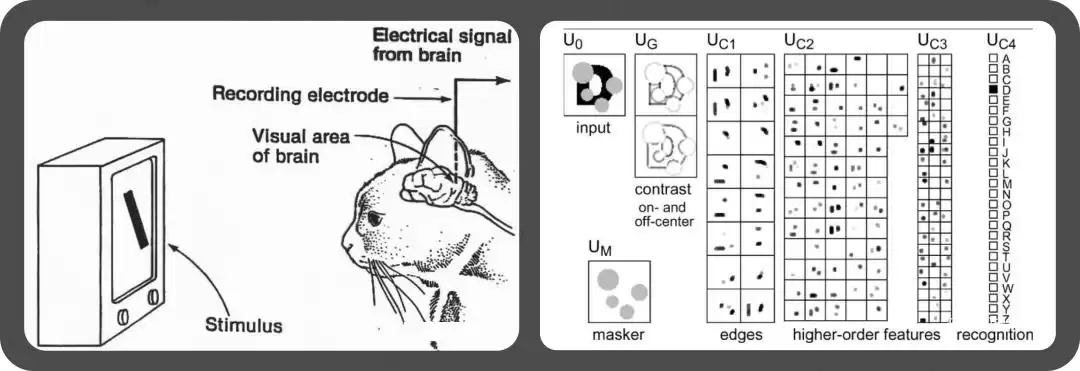

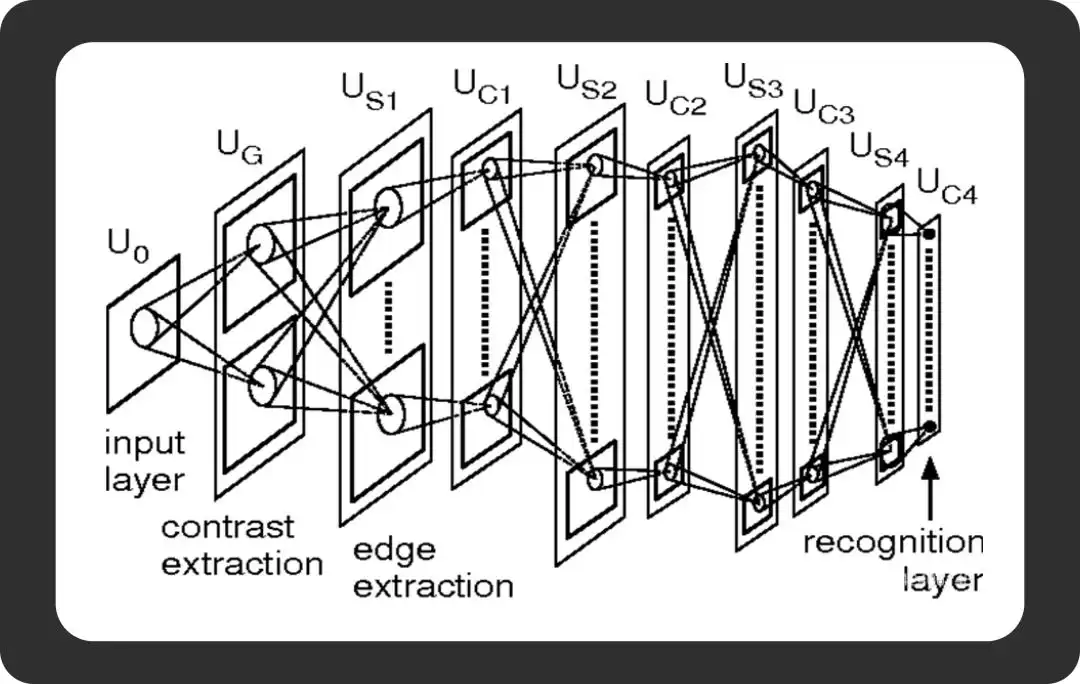

同一时期,另一条战线悄然开启。1979年,日本科学家福岛邦彦提出Neocognitron网络,模仿视觉皮层工作机制。这一看似晦涩的模型,实为现代卷积神经网络(CNN)的雏形,更是深度学习图像处理的起点。

其灵感源自Hubel和Wiesel对猫视觉皮层的研究,模拟了简单与复杂细胞协作机制。通过视觉刺激观察脑部电信号,他们提出了关键假设。

福岛则构建了类似网络用于模式识别:先辨边缘,再识特征,最终完成模式匹配——这正是深度学习核心逻辑的早期彰显。

福岛为此设计了多层网络结构,明确“简单单元”与“复杂单元”的映射关系,构建了层次化识别框架。

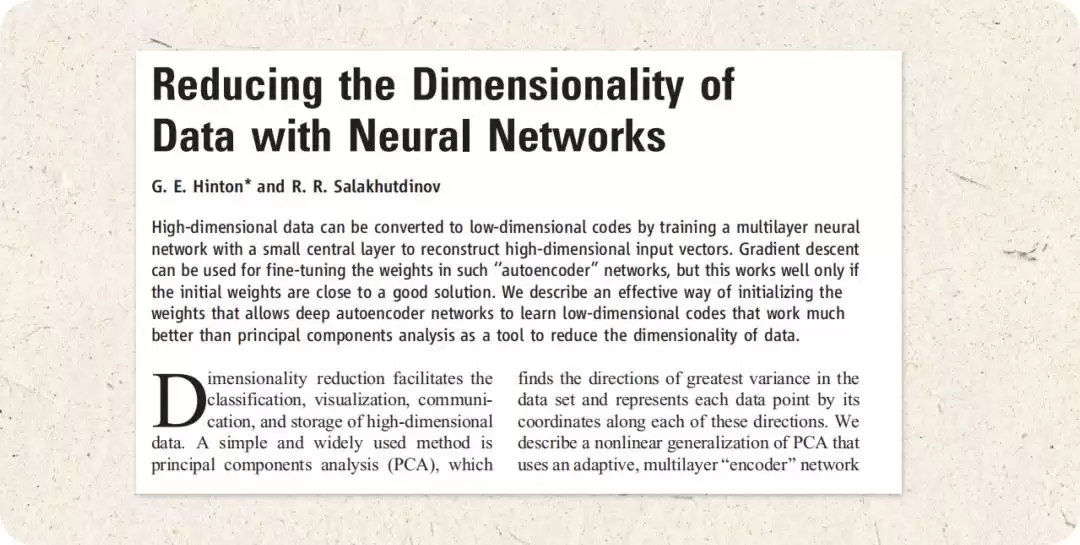

1985年,Geoffrey Hinton与同事发明玻尔兹曼机。其核心直白:让机器通过统计学自主发现数据规律,如同人类从大量画作中领悟“美”的本质。

玻尔兹曼机的奥秘在于“无监督学习”——它能自主探寻数据背后的隐藏模式。 无需逐步指令,仅通过调整内部权重即可理解复杂信息。这一过程借鉴统计力学,故以“玻尔兹曼”为名。

简言之,它如同一个充满开关与磁铁的盒子,通过随机拨动开关趋向“最舒适状态”(能量最低),并通过观察案例学会调整磁铁间的吸引与排斥。

深度学习的“觉醒”

2006年成为分水岭。Hinton在《Science》上发表里程碑论文,证明了深度神经网络可被高效训练。这意味着机器终于掌握了从海量数据中提取关键特征的能力——如同获得一双理解世界的“慧眼”,为后续爆发奠定基础。

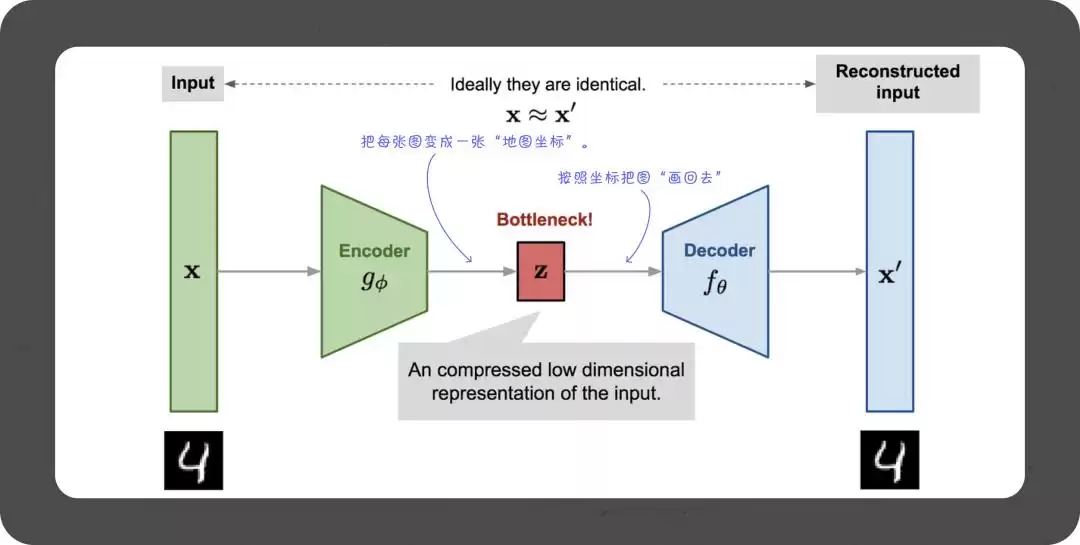

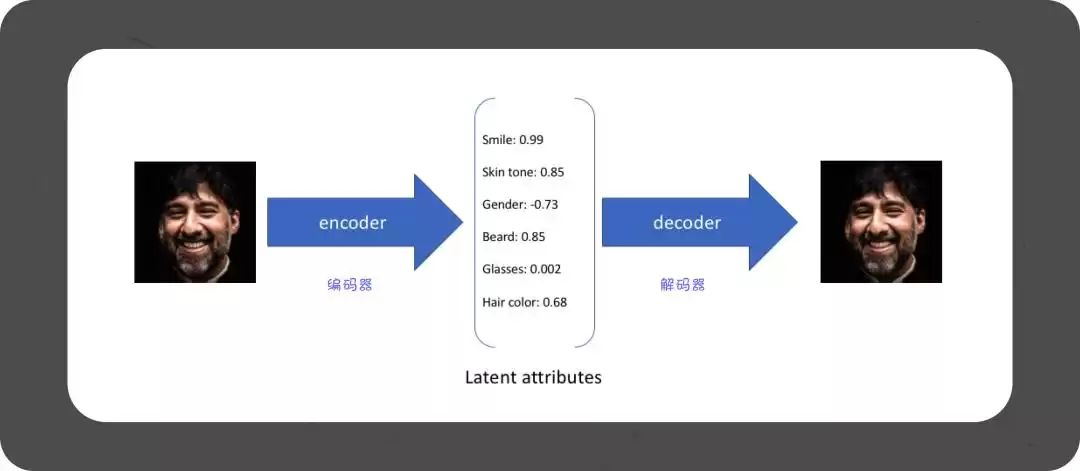

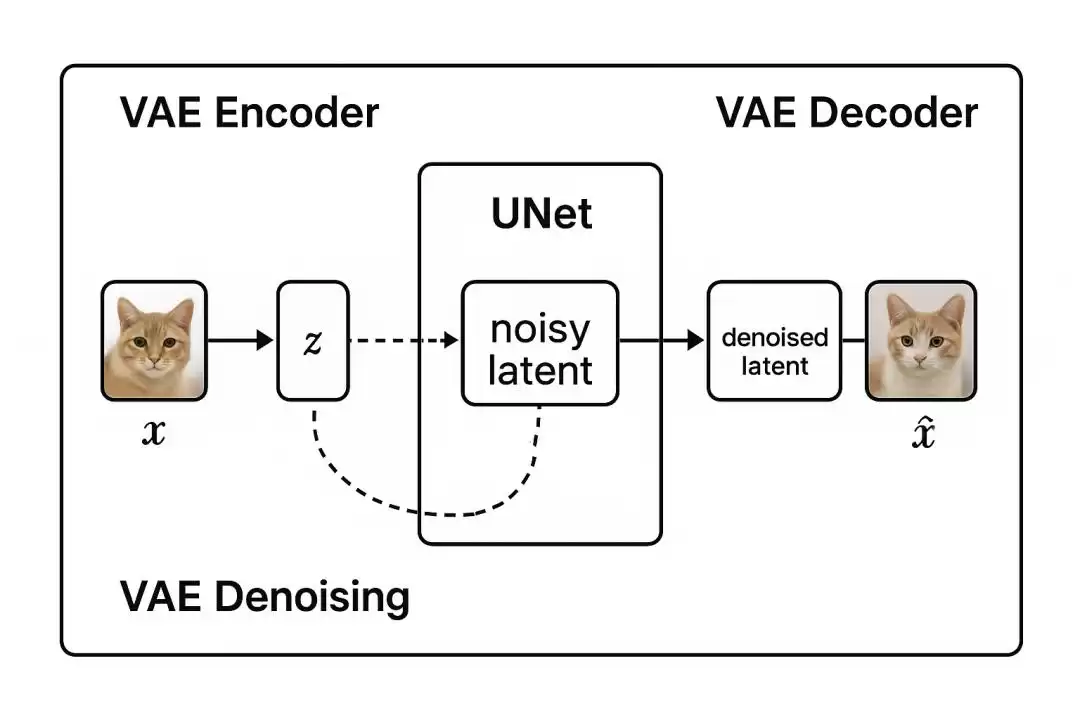

变分自编码器(VAE):第一次真正的“创作”

2013年12月,Kingma和Welling提出变分自编码器(VAE)。它的革命性在于:不仅复制图像,更能创造前所未见的新图像。

VAE巧妙融合概率图模型的“变分推断”与神经网络的“反向传播”:编码器将输入x转为隐变量z的概率分布;解码器将z还原为x的分布;目标函数通过“重构误差+KL散度”实现生成与估计的平衡。

想象教导孩子画苹果:传统方法是临摹现有苹果,而VAE让孩子理解“苹果”的本质,从而画出任何苹果——甚至创造全新品种。

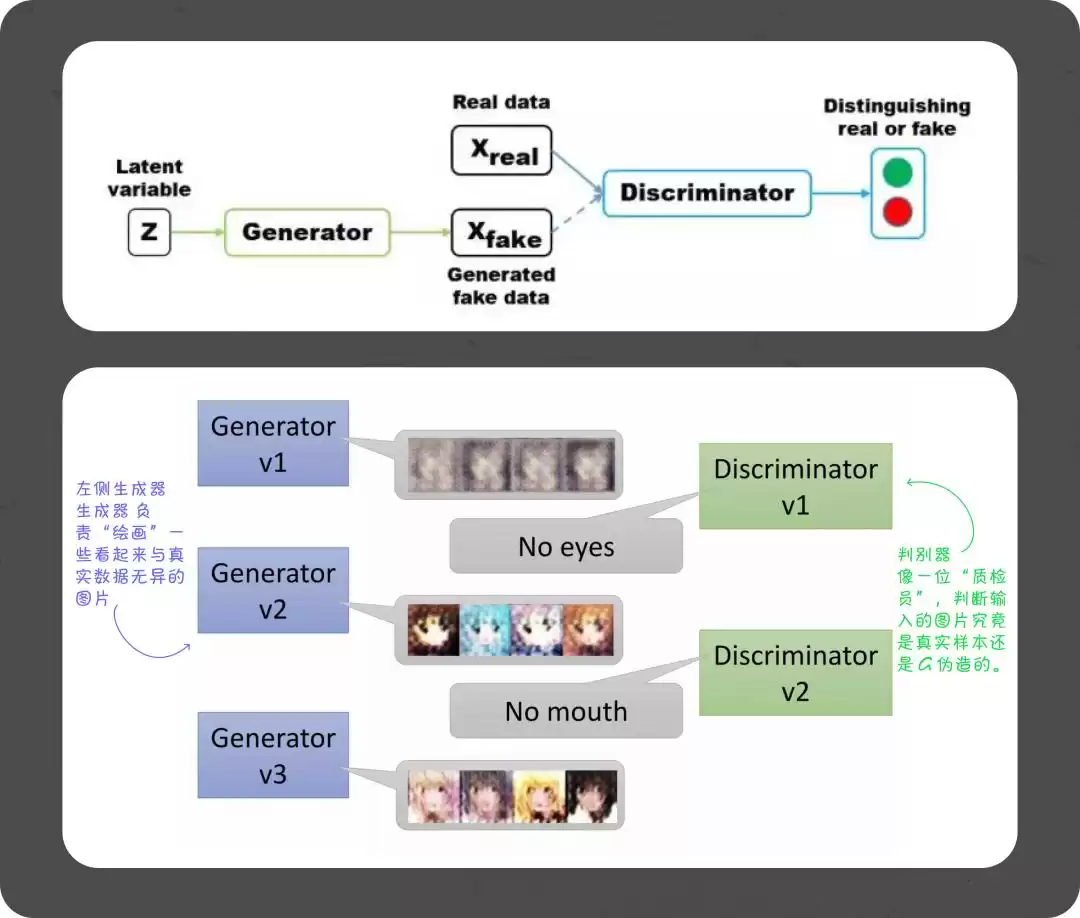

GAN的诞生:一场“艺术较量”

2014年6月,蒙特利尔酒吧里的灵感火花,催生了生成对抗网络(GAN)。Ian Goodfellow的奇想很简单:让两个神经网络对抗。一个专注“创作”(生成器),一个负责“鉴伪”(判别器)。两者在博弈中共同进化,如同艺术家在竞争中突破极限。

GAN 的核心是双网络对抗:

生成器(Generator):创作以假乱真的图像。判别器(Discriminator):担任“质检员”,区分真实与伪造。

训练中,二者不断博弈:生成器提升“造假”水准,判别器磨练“辨伪”能力。当判别器难辨真伪时,生成器便能产出高质量图像。

但GAN存在两大痛点:

1. 训练成本高昂:对抗训练耗时耗力,极易导致GPU崩溃。

2. 局部编辑困难:GAN对图像理解粗糙,难以精准修改局部(如只改眼睛不动全脸)。

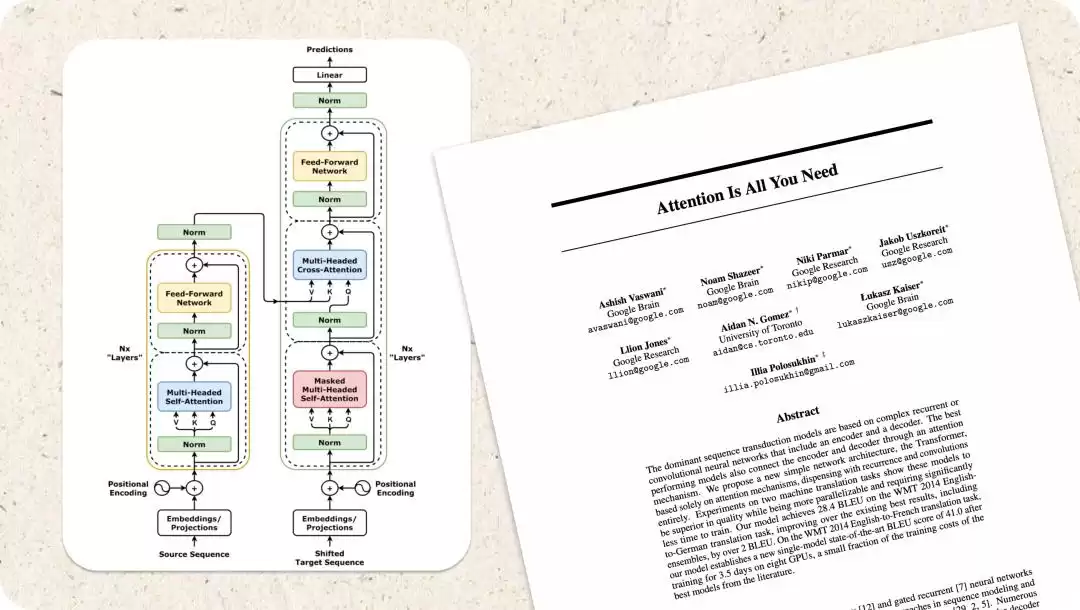

Transformer:注意力机制的革命

2017年,Google的论文《Attention is All You Need》提出Transformer架构。这一专注于自然语言处理的技术,意外为AI领域带来全面变革。

其核心“注意力机制”让AI能聚焦关键信息,如同人类阅读时抓重点。这不仅提升了语言理解,更为多模态AI铺平道路。

起初,人们未料其影响深远。但Transformer迅速展现优势:处理任意长度序列、并行计算高效,更重要的是为文字、图像、音频的多模态融合提供了统一框架。

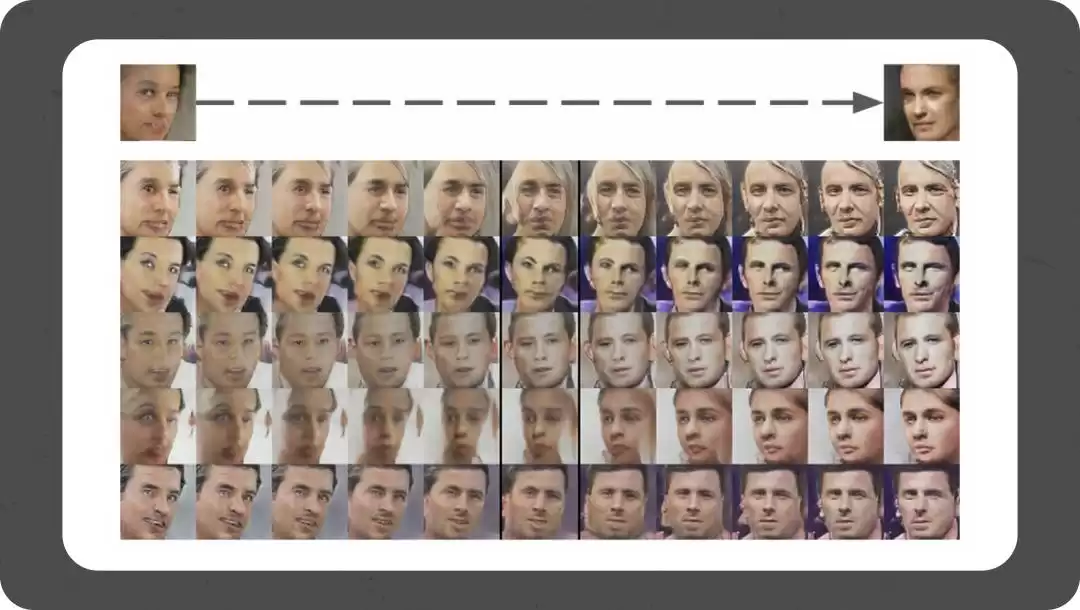

StyleGAN:给AI艺术家更多控制权

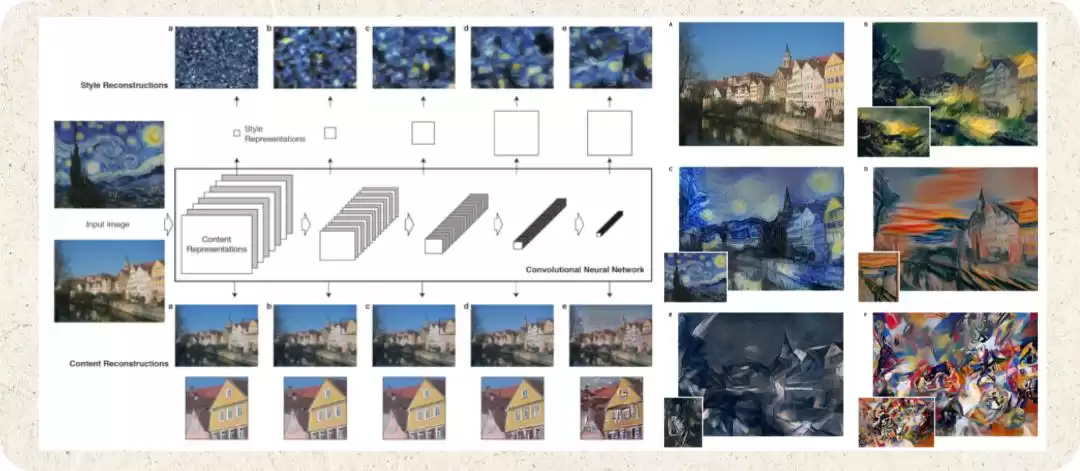

2018年底,NVIDIA推出StyleGAN,实现质的飞跃。它让AI不仅画得像,更能画得“有风格”。传统AI如模仿学徒,StyleGAN则如风格多变的艺术家。你可指令:“画一个人,带梵高笔触”或“保持五官,变换发色表情”。

此后,类似功能遍地开花,例如将普通照片转为梵高风格:

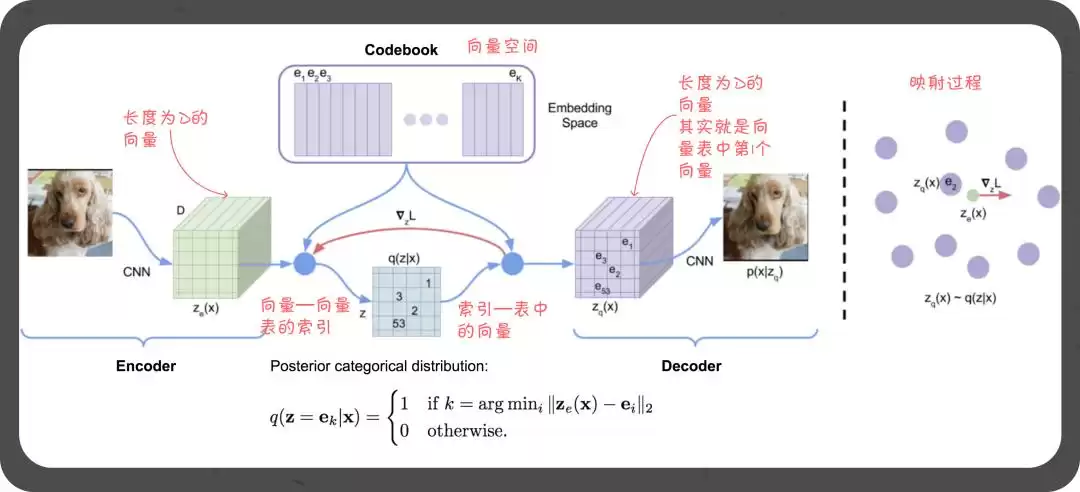

VQ-VAE-2:分层思考的智慧

2019年,DeepMind的VQ-VAE-2引入分层思维。它模仿人类绘画:先构思整体布局,再细化局部。顶层网络把握宏观如“海边日落”,底层网络雕琢细节如“海浪纹理”。这种分层策略为后续先进模型提供了关键启示。

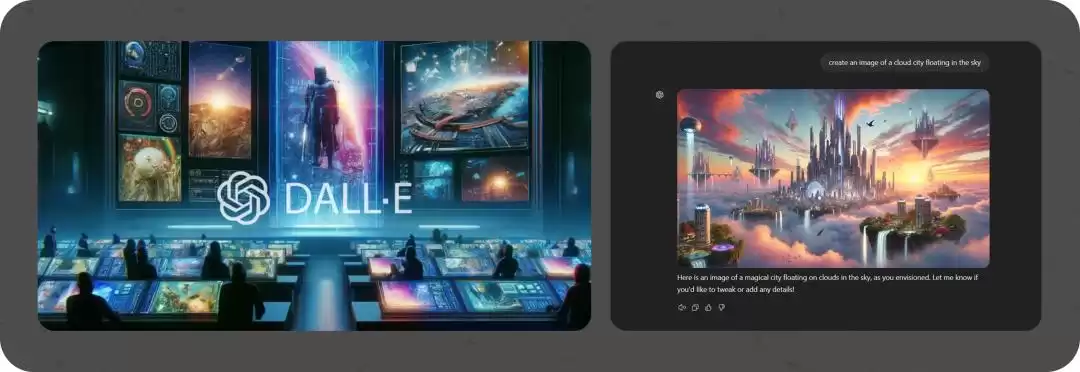

DALL-E:会读文字的AI画家

2021年1月,OpenAI发布DALL-E,开启历史新篇章。首个真正理解语言并转化为图像的AI诞生。 凭借120亿参数,它如拥120亿“神经元”的大脑。输入“戴侦探帽的鳄鱼雨天查案”,它便能创作。更惊人的是,即使面对训练中未见的奇异组合,它也能合理生成。与当时主流GAN不同,DALL·E将文本与图像离散化为token,用自回归Transformer统一建模,首次实现“一句话出图”。

其名融合艺术与科技:“DALL”致敬超现实主义大师达利,“-E”呼应机器人瓦力。

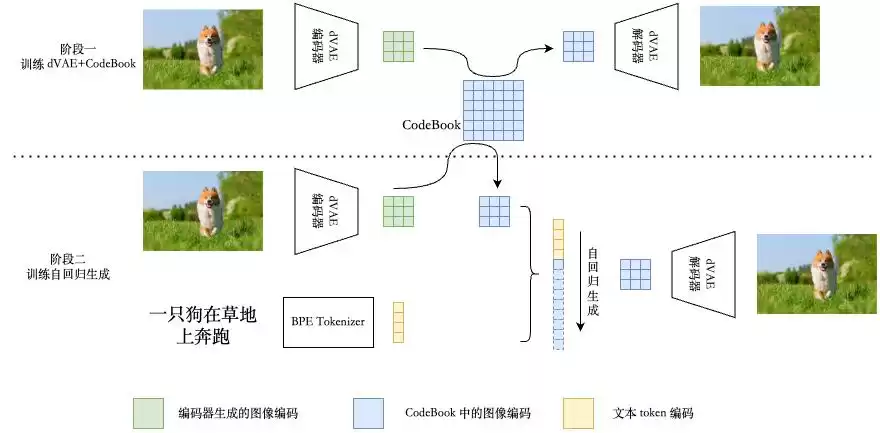

DALL·E 1 的流程可简化为四步,如同“写作文→画草图→上色→交卷”:

1. BPE Tokenizer:将输入文本切分为token,如“一只穿西装的猫”化为字符编号。

2. dVAE 编码器:将参考图压缩为32×32“马赛克草图”,每格用色号表示。

3. Transformer 大脑:作为“语文兼美术老师”,按顺序预测每个方格的色号,自回归生成完整草图。

4. dVAE 解码器:将草图解码为256×256高清图像,完成输出。

一句话概括:文字→token化→草图→Transformer生成→解码放大→成品图像。

这一路线带来三大突破:

跨模态对齐:文本与视觉元素精准对应,支持“穿西装的牛油果坐在法庭上”等复杂概念。零样本泛化:无需微调即可生成未见概念。局部可控:通过修改文本或掩码,可单独调整图像区域,解决GAN“牵一发动全身”的难题。

DALL·E 标志着“文本→图像”生成步入实用,为DALL·E 2、Stable Diffusion、Midjourney等模型奠定基础。

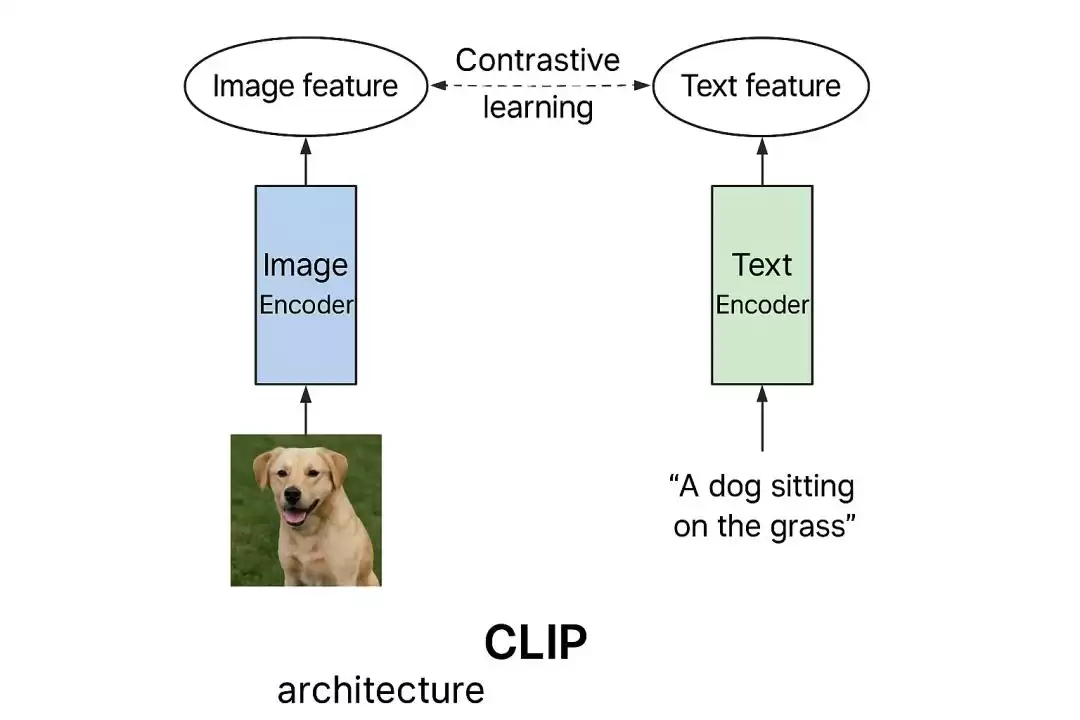

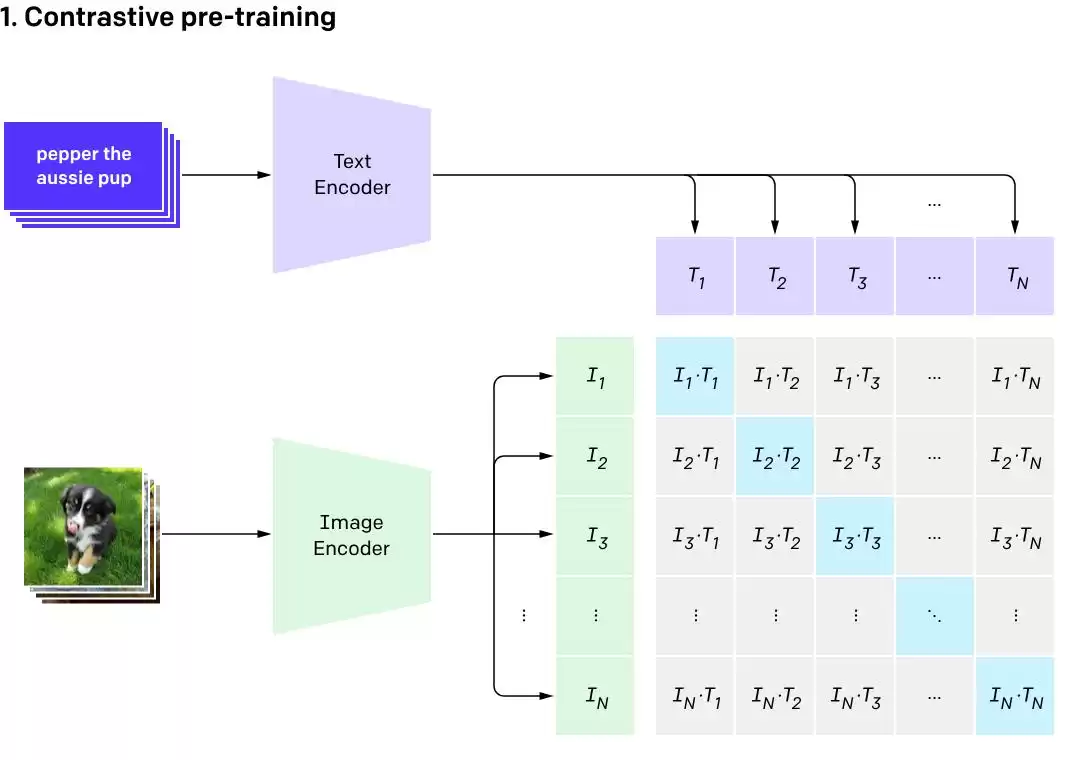

CLIP:视觉与语言的桥梁

同一年,OpenAI推出CLIP(对比式语言-图像预训练)。它虽不直接生成图像,却架起了视觉与语言的桥梁,核心是用自然语言监督训练通用表征模型。

CLIP如同双语翻译,既能理解图像含义,也能解读文字,并建立二者关联。它通过对比学习,在4亿图文对上对齐文本与图像编码器的语义空间,为后续文本生成图像系统提供了“语言理解”基石。

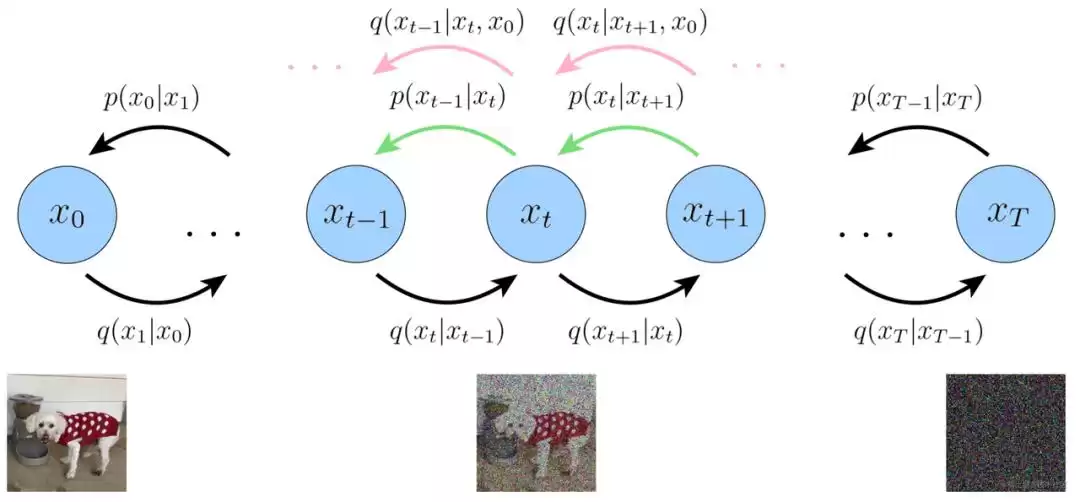

扩散模型:从噪声中诞生的艺术

灵感源自2015年斯坦福研究,受分子扩散现象启发。想象墨水滴入水中渐散为灰,扩散模型则学会“逆过程”——从均匀灰色重聚为清晰墨滴。

其核心充满诗意:从纯噪声起步,逐步去噪,“雕琢”出清晰图像。如同雕塑家从顽石中唤醒杰作。

扩散模型分两步:正向与反向扩散。

正向扩散:基于马尔可夫链,为图像逐步添加噪声,经上千次迭代化为纯随机噪声。反向扩散:训练神经网络(常为U-Net)预测并去除噪声,逐步还原数据细节,使图像从模糊渐显清晰。

2020-2021年,研究发现扩散模型质量超越GAN,且训练更稳定。这如发现天赋与服从兼具的学生,迅速引领行业风潮。

Midjourney的出现开启ai绘图纪元

2022年7月,Midjourney以Discord聊天机器人形式公测,打破AIGC大厂垄断。作为精调生成模型,它迅速吸引980万用户,掀起全民AI创作热。

同年8月,游戏设计师Jason Allen凭AI作品《太空歌剧院》斩获美国科罗拉多州博览会数字艺术一等奖,“AI绘画”引发全球轰动。

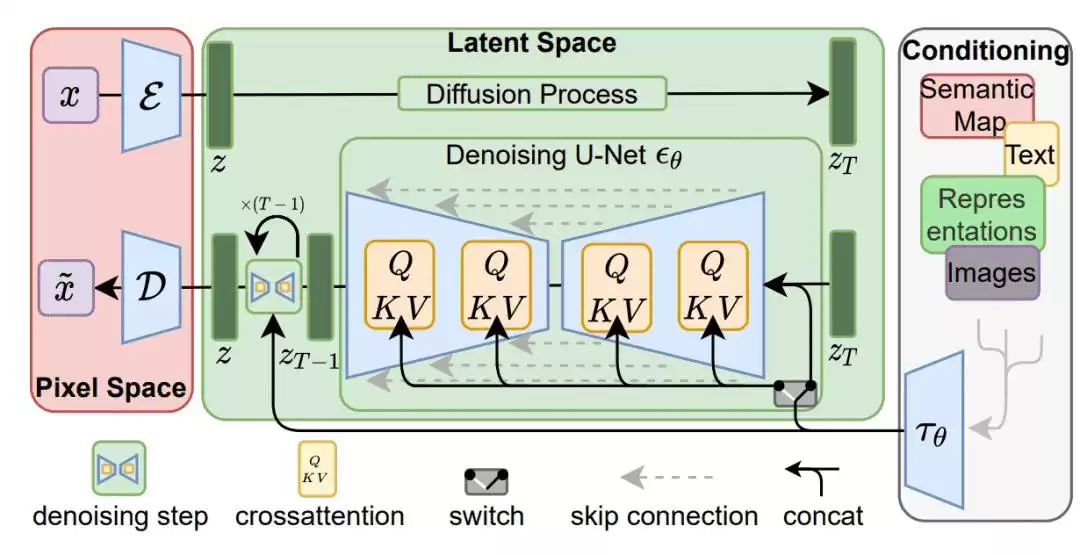

Stable Diffusion:开源的力量

2022年8月,Stability AI将Stable Diffusion开源,如同将昂贵艺术工具免费共享全球。其强大不仅在于生成质量,更在于消费级显卡即可运行。 为何名“Stable”?并非数学稳定,而是相对早期模型,它显存占用低、训练收敛稳、生态更繁荣。

基于潜在扩散模型(LDM),它在保持质量的同时大幅降低算力需求。一夜之间,人人皆可成为“AI艺术导演”,社交媒体瞬间涌现海量AI作品,从专业设计到日常创作,应用遍地开花。

Stable Diffusion 实为三段式流水线:潜空间换效率,文本嵌入做导向,将千步扩散压缩至50步,轻松运行于消费级显卡。

CLIP编码文本:77个token各768维,浓缩语义。U-Net潜空间降噪:从噪声张量逐步去噪,输出4×64×64潜图。VAE解码放大:将潜图转为512×512高清图,完成创作。

以上梳理了AI生图模型的技术演进。当前主流集中于扩散模型与自回归模型,二者差异我们下次深入探讨。

从粗糙像素到智能创作,AI图像生成已彻底改变视觉内容的生产方式。无论你是设计师、艺术家,还是普通爱好者,这场革命都与你息息相关。现在就动手尝试吧——用Stable Diffusion或Midjourney,释放你的创造力,绘制属于你的AI未来!

本文由 @LULAOSHI 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图由作者提供

相关问答

图像处理技术解析-ZOL问答

图像处理技术指利用计算机操作和分析图像信息的技术,涵盖数字化转换、质量增强、编码压缩、分割提取、特征识别等核心领域。

图形图像技术是什么?

图形图像处理技术聚焦计算机图形学与图像处理前沿,主要研究虚拟现实算法、高动态范围(HDR)成像等方向。

图像处理技术主要包括什么?

图像处理技术利用计算机和数字信号处理对图像进行分析与增强,主要包括图像获取预处理、质量优化、压缩编码、内容分割识别等环节。

图形图像应用技术是什么?

这是工业设计、视觉传达、多媒体等领域的核心技能,涉及计算机图形学与图像处理的研究与应用探索。

vr是干什么的?

VR(虚拟现实)综合计算机图形与交互设备,生成可沉浸交互的三维环境,具备交互性、沉浸感、想象力三大特征。

图像处理技术有哪些应用领域?-ZOL问答

图像处理技术应用广泛,涵盖医疗影像、安防监控、自动驾驶、娱乐媒体等众多领域,通过数字化与智能分析提升各行业效率。

电力半导体器件驱动电路的具体形式-汽车维修技术网

[回答]根据控制端与公共端信号特性,电力电子器件分为电流驱动与电压驱动两类。其驱动电路形式多样,需结合具体器件设计。

阐述对视频图像侦查技术知识体系的理解?

视频图像侦查技术体系主要包括视频摘要(浓缩关键内容)、视频检索(通过人车物目标识别实现高效搜索)、车辆大数据分析等核心能力。

ct影像放大技术有哪些?

CT影像放大技术主要包括靶扫描(小范围薄层扫描放大病灶)与扫描后图像数字放大,旨在提升局部细节清晰度。

图像识别技术原理详解?

图像识别技术通过计算机模拟人类视觉,结合数字图像处理与机器学习,对输入图像进行识别分析,实现智能化信息提取。